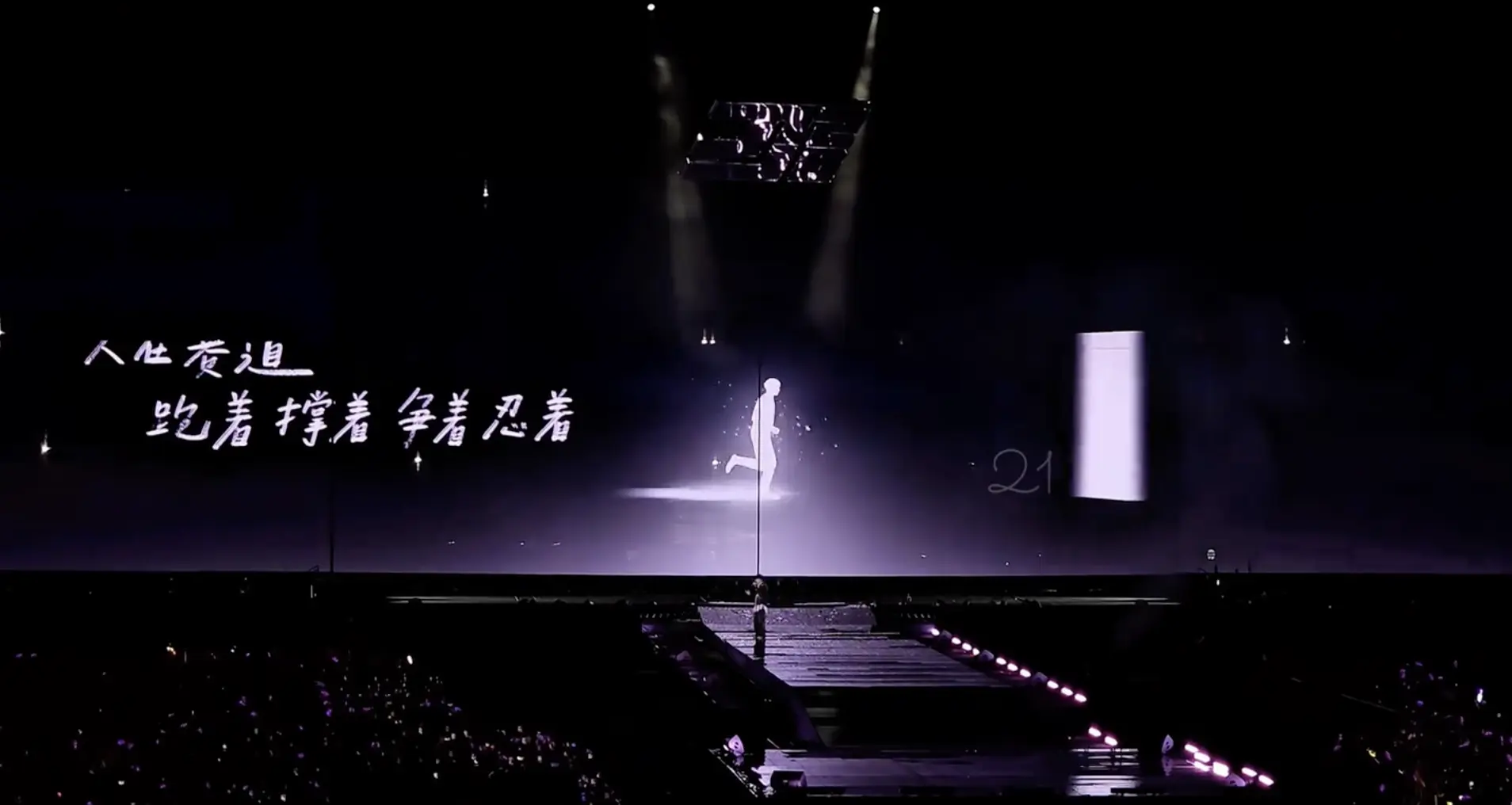

我们(主要是cjy本人)选择做 aigc 的“伟大梦想”是给 JJ20 这样的演唱会做舞美,因此保研时还曾斗胆联系过做 CG 的课题组,然而面谈时一听到每天要和一帮 CMO / CPHO 的的天才一起做仿真、解方程,就给我吓跑了。于是有了这样的一条迂回的路线:用高质量的图片来配合短镜头视频的生成。

在前段时间,我们的图像生成系统(dcc)进入了“能跑”的状态,其作为系统的一个重要特征是:相较于单纯的文本控制图像生成模型,系统中蕴含了更多的背景信息并实现了更好的用户意图分解。仍以 JJ20 演唱会曲目光阴副本为例,舞美其实与多个因素(歌词、曲调、演唱者的心态等)有关,而非单纯的文本控制。

因此,我希望系统能够包含更多的信息(只是因为现在的模型是文本输入为主,因此这些信息暂时都被对齐到文本上)。在近期的时间里,我们成功地验证了这个特征的效果。我们协助制作了一些北京的民俗/文化/饮食的视觉输出,对于系统来说,它的输入是...

10本书。

What??? 市面上有这么大上下文窗口的生图模型吗?因此我们实际上完成的是:数据标注 -> 背景知识库构造 -> 特定生图任务规约 -> 图像生成 -> 视频生成的系统步骤(当然,作为系统,它的自动化程度也足够高了,上百万字的文字处理,上百个图像生成需求描述,我们做到了 all in one)。

一方面,非常开心我们的工作可以为一个大的项目(此项目仍在比赛中,因此不便介绍)贡献绵薄之力;另一方面,也在实践中看到了向“伟大梦想”迈出的一小步。那就继续做下去吧!